xAR:字節跳動與霍普金斯大學聯合推出的新一代自回歸視覺生成框架

隨著人工智能技術的飛速發展,視覺生成領域正迎來新一輪的技術革新。近日,字節跳動與約翰·霍普金斯大學聯合推出了名為xAR的新型自回歸視覺生成框架,這一技術在性能和應用上均取得了顯著突破,為圖像生成領域注入了新的活力。

什么是xAR?

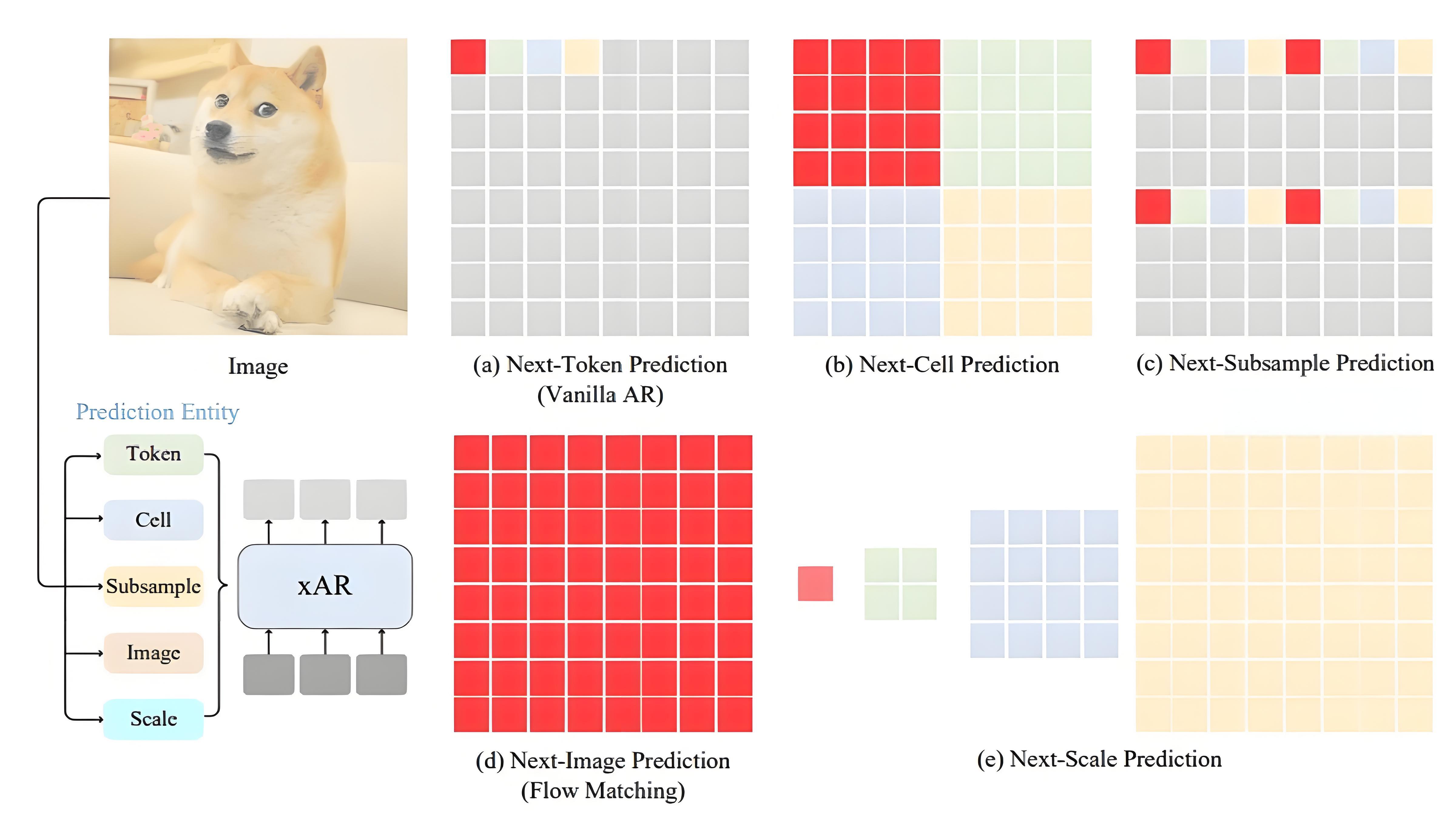

xAR(eXtended Autoregressive)是一種基于自回歸方法的視覺生成框架,由字節跳動與約翰·霍普金斯大學的研究團隊共同開發。與傳統自回歸模型相比,xAR通過兩項創新技術——Next-X Prediction和Noisy Context Learning,有效解決了傳統模型在視覺生成中的信息密度不足和累積誤差問題。

xAR的核心技術

-

Next-X Prediction(下一個X預測) xAR擴展了傳統的“下一個標記預測”方法,支持模型預測更復雜的視覺實體,如圖像塊、單元、子采樣甚至整個圖像。這種技術能夠捕捉更豐富的語義信息,顯著提升生成圖像的質量和細節。

-

Noisy Context Learning(噪聲上下文學習) 在訓練過程中,xAR通過引入噪聲,提高了模型對誤差的魯棒性。這一技術能夠有效緩解自回歸模型在生成過程中常見的累積誤差問題,確保生成結果的穩定性。

-

流匹配(Flow Matching) xAR基于流匹配方法,將離散的標記分類問題轉化為連續的實體回歸問題。具體來說,模型通過插值和噪聲注入生成帶噪聲的輸入,并在每個自回歸步驟中預測從噪聲分布到目標分布的方向流(Velocity),逐步優化生成結果。

xAR的性能優勢

在ImageNet數據集上,xAR展現出了卓越的性能:

-

xAR-B(1.72億參數):推理速度比DiT-XL(6.75億參數)快20倍,同時在弗雷歇 inception 距離(FID)上達到1.72,優于現有擴散模型和自回歸模型。

-

xAR-H(11億參數):在ImageNet-256基準測試中,FID達到1.24,創造了新的最優水平,且不依賴于視覺基礎模型或高級引導區間采樣。

xAR的應用場景

xAR的靈活性和高性能使其在多個領域具有廣泛的應用潛力:

-

藝術創作 藝術家可以利用xAR生成創意圖像,作為藝術作品的靈感來源或直接用于創作。xAR支持不同分辨率和風格的生成需求,能夠生成具有豐富細節和多樣風格的圖像。

-

虛擬場景生成 在游戲開發和虛擬現實(VR)中,xAR可以快速生成逼真的虛擬場景,包括自然景觀、城市環境和虛擬角色等,顯著提升用戶體驗。

-

老照片修復 通過生成高質量的圖像內容,xAR可以修復老照片中的損壞部分,恢復其原始細節和色彩,為文化遺產保護提供技術支持。

-

視頻內容生成 xAR可以生成視頻中的特定場景或對象,用于視頻特效制作、動畫生成和視頻編輯,為影視行業帶來新的創作工具。

-

數據增強 通過生成多樣化的圖像,xAR可以擴充訓練數據集,提升模型的泛化能力和魯棒性,為機器學習任務提供更高質量的訓練數據。

xAR的未來展望

xAR的成功不僅展示了字節跳動與約翰·霍普金斯大學在人工智能領域的深厚積累,也為視覺生成技術的發展指明了方向。隨著技術的不斷優化和應用場景的拓展,xAR有望在藝術創作、虛擬現實、影視制作等領域發揮更大的作用。

結語

xAR作為新一代自回歸視覺生成框架,以其創新的技術和卓越的性能,正在重新定義視覺生成的邊界。無論是技術開發者、設計師還是普通用戶,都可以從中受益,感受人工智能帶來的無限可能。