DiffRhythm:AI音樂生成新突破,快速打造個(gè)性化音樂作品

DiffRhythm 由西北工業(yè)大學(xué)和香港中文大學(xué)(深圳)的研究團(tuán)隊(duì)聯(lián)合開發(fā),旨在解決現(xiàn)有音樂生成工具的局限性,如生成完整長(zhǎng)歌的困難、復(fù)雜多階段架構(gòu)和慢速推理等問題。

-

它基于潛擴(kuò)散模型,首次實(shí)現(xiàn)端到端生成包含人聲和伴奏的完整歌曲,長(zhǎng)達(dá) 4 分 45 秒,僅需 10 秒。

-

相比傳統(tǒng)工具,DiffRhythm 采用非自回歸結(jié)構(gòu),簡(jiǎn)化數(shù)據(jù)管道,提升可擴(kuò)展性,適合藝術(shù)創(chuàng)作、教育和娛樂應(yīng)用。

-

開發(fā)團(tuán)隊(duì)強(qiáng)調(diào)其簡(jiǎn)單性,旨在讓用戶無(wú)需復(fù)雜設(shè)置,僅需歌詞和風(fēng)格提示即可生成音樂。

網(wǎng)絡(luò)搜索結(jié)果(如 DiffRhythm AI Music Generator)進(jìn)一步證實(shí)其快速生成和高品質(zhì)輸出,受到用戶好評(píng),尤其在處理復(fù)雜歌詞和多語(yǔ)言支持方面表現(xiàn)突出。

核心功能與優(yōu)勢(shì)

DiffRhythm 的功能設(shè)計(jì)貼合用戶需求,以下為詳細(xì)列表:

| 功能 | 描述 |

|---|---|

| 快速生成完整音樂 | 10 秒內(nèi)生成長(zhǎng)達(dá) 4 分 45 秒的歌曲,包括人聲和伴奏,效率遠(yuǎn)超傳統(tǒng)工具。 |

| 歌詞驅(qū)動(dòng)的音樂創(chuàng)作 | 用戶輸入歌詞和風(fēng)格提示(如“流行”“古典”),自動(dòng)生成匹配的旋律和伴奏。 |

| 高質(zhì)量音樂輸出 | 旋律流暢,歌詞清晰,適合影視配樂、短視頻背景音樂等場(chǎng)景。 |

| 靈活的風(fēng)格定制 | 支持多種風(fēng)格調(diào)整,通過簡(jiǎn)單提示滿足多樣化創(chuàng)作需求。 |

| 開源與可擴(kuò)展性 | 提供訓(xùn)練代碼和預(yù)訓(xùn)練模型,支持用戶自定義開發(fā)和二次創(chuàng)作。 |

| 創(chuàng)新的歌詞對(duì)齊技術(shù) | 通過句子級(jí)對(duì)齊機(jī)制,確保人聲與旋律高度匹配,提升聽覺體驗(yàn)。 |

這些功能使其成為專業(yè)音樂人、獨(dú)立創(chuàng)作者和教育者的理想工具。例如,網(wǎng)絡(luò)搜索顯示用戶評(píng)價(jià)其在生成英中雙語(yǔ)歌曲時(shí)的多功能性,特別適合跨文化創(chuàng)作。

技術(shù)原理

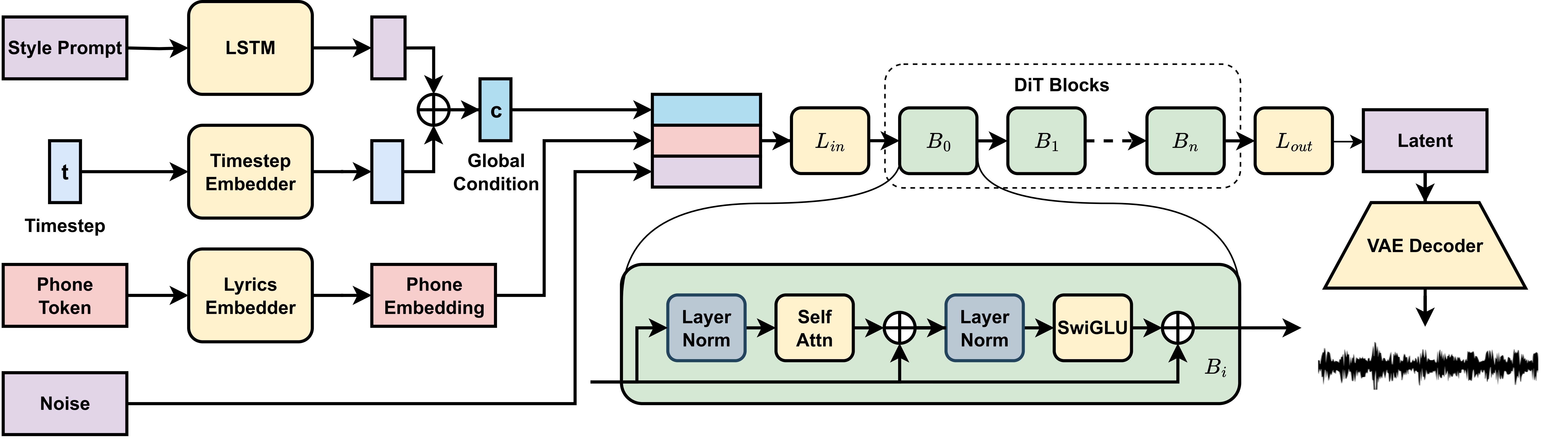

DiffRhythm 的技術(shù)核心基于潛擴(kuò)散模型,結(jié)合變分自編碼器(VAE)和擴(kuò)散變換器(Diffusion Transformer):

-

潛擴(kuò)散模型:通過前向加噪將音樂片段逐步轉(zhuǎn)為白噪聲,再通過預(yù)訓(xùn)練神經(jīng)網(wǎng)絡(luò)反向去噪,生成符合用戶需求的音樂。

-

自編碼器結(jié)構(gòu):VAE 將音頻信號(hào)壓縮為潛在特征表示,擴(kuò)散模型生成新特征,最后解碼為音頻輸出,降低計(jì)算復(fù)雜度。

-

擴(kuò)散變換器:基于變換器架構(gòu),利用交叉注意力層和門控多層感知器處理長(zhǎng)上下文窗口,確保音樂結(jié)構(gòu)連貫。

這些技術(shù)使 DiffRhythm 能在短時(shí)間內(nèi)生成高質(zhì)量、結(jié)構(gòu)完整的長(zhǎng)歌,網(wǎng)絡(luò)搜索結(jié)果(如 DiffRhythm 技術(shù)論文)詳細(xì)闡述其方法,強(qiáng)調(diào)其在音樂生成領(lǐng)域的創(chuàng)新性。

使用方法與資源

用戶可以多種方式訪問 DiffRhythm:

-

在線平臺(tái):通過 Hugging Face Space (DiffRhythm Space) 體驗(yàn),無(wú)需本地設(shè)置,適合初學(xué)者。

-

本地運(yùn)行:從 GitHub 倉(cāng)庫(kù) (DiffRhythm GitHub) 下載,安裝 Python 3.10 和相關(guān)依賴(如 espeak-ng),需至少 8GB VRAM。

-

輸入與生成:提供 lrc 格式歌詞和參考音頻,指定風(fēng)格提示,運(yùn)行推理腳本生成歌曲。

網(wǎng)絡(luò)搜索顯示,部分第三方平臺(tái)(如 DiffRhythm AI)也提供在線工具,但建議使用官方資源以確保安全性。項(xiàng)目資源包括:

-

官方網(wǎng)站 (DiffRhythm 官網(wǎng))

-

Hugging Face 模型庫(kù) (Hugging Face Models)

-

技術(shù)論文 (技術(shù)論文)

應(yīng)用場(chǎng)景與潛在影響

DiffRhythm 的應(yīng)用場(chǎng)景涵蓋多個(gè)領(lǐng)域:

| 場(chǎng)景 | 具體應(yīng)用 |

|---|---|

| 音樂創(chuàng)作輔助 | 為音樂人提供靈感,快速生成包含人聲和伴奏的歌曲框架。 |

| 影視與視頻配樂 | 為影視制作、游戲開發(fā)和短視頻生成匹配情緒的背景音樂,提升作品感染力。 |

| 教育與研究 | 生成教學(xué)用音樂示例,幫助學(xué)生理解不同風(fēng)格和結(jié)構(gòu),適合音樂教育研究。 |

| 獨(dú)立音樂人與個(gè)人創(chuàng)作 | 獨(dú)立音樂人無(wú)需復(fù)雜設(shè)備,快速生成高質(zhì)量作品,支持多語(yǔ)言歌詞輸入。 |

然而,潛在風(fēng)險(xiǎn)不容忽視:

- 版權(quán)問題:生成的音樂可能與現(xiàn)有作品相似,需驗(yàn)證原創(chuàng)性,避免侵權(quán)。

- 文化誤用:可能不恰當(dāng)?shù)厝诤喜煌幕魳吩兀柚?jǐn)慎使用。

- 有害內(nèi)容風(fēng)險(xiǎn):存在被用于生成不適當(dāng)內(nèi)容的可能性,開發(fā)團(tuán)隊(duì)建議披露 AI 參與并獲取保護(hù)風(fēng)格的許可。

網(wǎng)絡(luò)搜索結(jié)果(如 DiffRhythm 風(fēng)險(xiǎn)討論)顯示,社區(qū)正在積極討論這些倫理問題,強(qiáng)調(diào)負(fù)責(zé)任使用的重要性。

與其他工具的比較

與其他 AI 音樂生成工具相比,DiffRhythm 的獨(dú)特之處在于其端到端生成完整長(zhǎng)歌的能力。傳統(tǒng)工具如 Melodist 或 MusicLM 往往僅生成孤立音軌或短段,推理速度較慢。而 DiffRhythm 的非自回歸結(jié)構(gòu)和潛擴(kuò)散模型使其在速度和質(zhì)量上領(lǐng)先,特別適合需要快速解決方案的用戶。